नवीनतम अपडेट और प्रमुख एआई कवरेज पर विशिष्ट सामग्री के लिए हमारे दैनिक और साप्ताहिक समाचार पत्र में शामिल हों। और अधिक जानें

अभिनेता स्कारलेट जोहानसन के साथ Openai की आवाज AI मॉडल की परेशानी में है, लेकिन यह कंपनी को इस श्रेणी में अपने ings को स्थानांतरित करने से नहीं रोकता है।

आज, CHATGPT निर्माता ने तीन नए स्वामित्व वाली आवाज का अनावरण किया है: GPT-4 O-Transcript, GPT-4 O-Mini-Transcript और GPT-4 O-MIN-TTS। ये मॉडल शुरू में CHATGPT निर्माता के एप्लिकेशन प्रोग्रामिंग इंटरफ़ेस (API) के माध्यम से उपलब्ध होंगे, जो तृतीय-पक्ष सॉफ़्टवेयर चालीस डेवलपर्स के लिए अपने स्वयं के एप्लिकेशन बनाने के लिए हैं। वे सीमित परीक्षण और मनोरंजन के लिए व्यक्तिगत उपयोगकर्ताओं के लिए कस्टम डेमो साइट, OpenAIFM पर भी उपलब्ध होंगे।

इसके अलावा, GPT-4 O-MINI-TTS मॉडल को कई पूर्व-सेटों से कस्टमाइज़ किया जा सकता है, जो कि उनके लहजे, पिच, टोन और अन्य आवाज गुणों को बदलने के लिए पाठ संकेतों द्वारा किया जा सकता है, जो उपयोगकर्ता किसी भी विशेष उपयोग के लिए जो कुछ भी पूछता है, उसे व्यक्त करता है, जो किसी विशेष उपयोग पर विचार करता है। फिर भी)। अब, यह तय करना है कि वे तय करते हैं कि उनका एआई कैसे लगता है जब वापस बोलते हैं।

ओपनईएआई तकनीकी कर्मचारियों के एक सदस्य जेफ हैरिस ने दिखाया कि उपयोगकर्ता एक समान ध्वनि के लिए एक ही ध्वनि पा सकता है जैसे कि कोयलिंग, एक शांत योग शिक्षक।

GPT-4O बेस के भीतर नई क्षमताओं की खोज और शुद्ध करना

मॉडल मौजूदा GPT -4O मॉडल Openai के प्रकार हैं जो मई 2024 में शुरू हो गए हैं और जो वर्तमान में CHATGPT पाठ को सशक्त बनाता है और कई उपयोगकर्ताओं के लिए आवाज का अनुभव है, लेकिन कंपनी ने उस बेस मॉडल को लिया है और इसे ट्रांसक्रिप्ट और स्पीच पर एक्सेल बनाने के लिए अतिरिक्त डेटा के साथ पोस्ट किया है। कंपनी ने यह स्पष्ट नहीं किया है कि मॉडल चैटैगप्ट में कब आ सकते हैं।

हैरिस ने कहा, “CHATGPT की लागत और व्यावसायिक व्यापार के मामले में थोड़ी अलग आवश्यकताएं हैं, इसलिए जब मुझे उम्मीद है कि वे इन मॉडलों में जाएंगे, तो अभी के लिए, यह प्रक्षेपण एपीआई उपयोगकर्ताओं पर केंद्रित है,” हैरिस ने कहा, “हैरिस ने कहा,” हैरिस ने कहा।

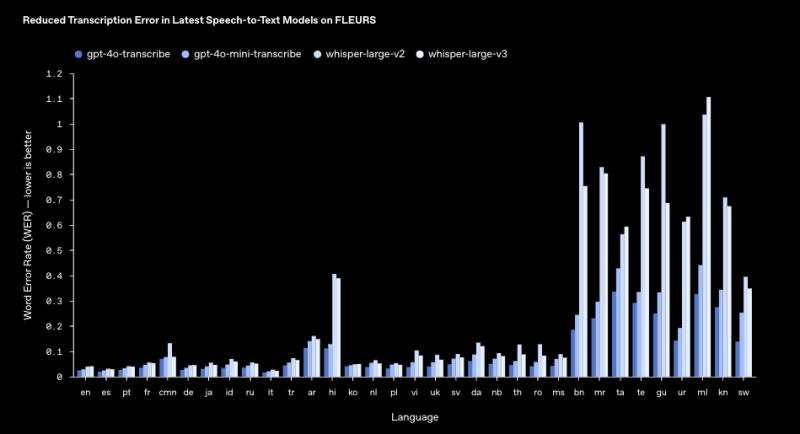

यह एक दो साल पुराने कानाफूसी ओपन-सन टेक्स्ट-टू-स्पीड मॉडल की पेशकश की जाती है, विभिन्न लहजे के साथ, विभिन्न लहजे के साथ, और 100+ भाषाओं में विभिन्न भाषण गति के साथ, उद्योग के बेंचमार्क में शोर वातावरण में कम शब्द त्रुटि दर और बेहतर प्रदर्शन की पेशकश की जाती है।

कंपनी ने अपनी वेबसाइट पर एक चार्ट पोस्ट किया, जिसमें दिखाया गया है कि GPT-4 O-Transcript मॉडल की त्रुटि दर 33 भाषाओं में शब्दों की पहचान करना है, जो कि अंग्रेजी में फुसफुसाते हुए 2.46% कम है।

“इन मॉडलों में वॉयस कैंसिलेशन और सिमेंटिक वॉयस शामिल हैं, वॉयस इश्यू एक्टिविटी डिटेक्टर है, जो यह निर्धारित करने में मदद करता है कि स्पीकर ने एक विचार कब पूरा किया है, प्रतिलेखन की सटीकता में सुधार करता है।”

हैरिस ने वेंचरबैट को बताया कि नया GPT -4 O -Transcript मॉडल परिवार के “दस्त”, या विभिन्न वक्ताओं के बीच लेबल और अंतर करने की क्षमता के लिए डिज़ाइन नहीं किया गया है। इसके बजाय, यह मुख्य रूप से एक इनपुट चैनल के रूप में एक (या संभवतः कई ध्वनियों) को प्राप्त करने के लिए है और इसे इंटरैक्शन में आउटपुट वॉयस समस्या के साथ सभी इनपुट का जवाब देने के लिए डिज़ाइन किया गया है, हालांकि इसमें अधिक समय लगता है।

कंपनी है आम जनता के लिए एक प्रतियोगिता को टैग करके Nline को साझा करें, इसकी डेमो आवाज का उपयोग करने के सबसे रचनात्मक उदाहरणों को खोजने के लिए साइट ओपन एएफएम है। विजेता को एक कस्टम किशोर इंजीनियरिंग रेडियो प्राप्त होगा। Openai लोगो, जो उत्पाद का Openai प्रमुख है, ने कहा कि प्लेटफॉर्म ओलिवर गोडेम ने कहा कि दुनिया में केवल तीन में से एक है।

एक ऑडियो डियो ऐप गोल्ड माइन

संवर्द्धन उन्हें ग्राहक कॉल एलटी सेंटर, नोट ट्रांसक्रिप्शन और एआई संचालित सहायकों जैसे अनुप्रयोगों के लिए विशेष रूप से उपयुक्त बनाते हैं।

वास्तव में, कंपनी के नए लॉन्च किए गए एजेंटों एसडीके ने पिछले सप्ताह से, डेवलपर्स पर अपने टेक्स्ट -आधारित बड़े -आधारित बड़े -आधारित बड़े -आधारित मॉडल जैसे नियमित रूप से जीपीटी -4O जैसे एक प्रस्तुतकर्ता के अनुसार, एक प्रस्तुतकर्ता के अनुसार, एक प्रस्तुतकर्ता के अनुसार, एक प्रस्तुतकर्ता के अनुसार, एक प्रस्तुतकर्ता के अनुसार, एक प्रस्तुतकर्ता के अनुसार, एक प्रस्तुतकर्ता के अनुसार, एक प्रस्तुतकर्ता के अनुसार, एक प्रस्तुतकर्ता के अनुसार, एक प्रस्तुतकर्ता के अनुसार, एक प्रस्तुतकर्ता के अनुसार, एक प्रस्तुतकर्ता के अनुसार, एक प्रस्तुतकर्ता के अनुसार, एक प्रस्तुतकर्ता के अनुसार, एक प्रस्तुतकर्ता के अनुसार, एक प्रस्तुतकर्ता के अनुसार, एक प्रस्तुतकर्ता के अनुसार, एक प्रस्तुतकर्ता के अनुसार, एक प्रस्तुतकर्ता के अनुसार, एक प्रस्तुतकर्ता के अनुसार, एक प्रस्तुतकर्ता के अनुसार, एक प्रस्तुतकर्ता के अनुसार, एक प्रस्तुतकर्ता के अनुसार, एक प्रस्तुतकर्ता के अनुसार, एक प्रस्तुतकर्ता के अनुसार, एक प्रस्तुतकर्ता के अनुसार, एक प्रस्तुतकर्ता के अनुसार, एक प्रस्तुतकर्ता के अनुसार, एक प्रस्तुतकर्ता के अनुसार, एक प्रस्तुतकर्ता के अनुसार, एक प्रस्तुतकर्ता के अनुसार।

उदाहरण के लिए, GPT-4O पर निर्मित E-CE MUS ऐप अब इन नए मॉडलों को जोड़कर एक झटका भाषण में “मेरे अंतिम आदेश के बारे में मुझे बताएं” जैसे टर्न-आधारित उपयोगकर्ता प्रश्नों का उत्तर दे सकता है।

हैरिस ने कहा, “पहली बार, हम स्ट्रीमिंग स्पीच-टू-टेक्स्ट की शुरुआत कर रहे हैं, जिससे डेवलपर्स को लगातार इनपुट ऑडियो डियो की अनुमति मिलती है और रियल-टाइम टेक्स्ट स्ट्रीम प्राप्त होती है,” हैरिस ने कहा, “बातचीत अधिक स्वाभाविक लगती है।”

फिर भी, वह ईश्वर के अनुभवों की तलाश कर रहा है, एक कम-गांठदार, वास्तविक समय एआई वॉयस आईएसएस, ओपनईई रियलटाइम एपीआई में अपने भाषण-टू-ऑल-राउंड मॉडल के उपयोग की सिफारिश करता है।

कीमतों और उपलब्धता

नए मॉडल डेल्स तुरंत Openai के API के माध्यम से उपलब्ध हैं, कीमतों के साथ:

• GPT -4 O -Transcript: 1 मीटर ऑडियो डियो इनपुट टोकन प्रति 1 मीटर (प्रति मिनट ~ $ 0.006)

• GPT-4O-Mini-Transcript: 1 मीटर ऑडियो डियो इनपुट टोकन प्रति 1 मीटर (प्रति मिनट ~ $ 0.003)

• GPT-4O-MINI-TTS: 1 एम टेक्स्ट इनपुट टोकन 0.60, 1 एम ऑडियो डियो आउटपुट टोकन 00 12.00 (प्रति मिनट ~ $ 0.015)

हालाँकि, वे आते हैं एआई ट्रांसक्रिप्शन और स्पीच स्पेस में भयंकर प्रतिस्पर्धा के समय, एआईआईएस जैसे समर्पित भाषण जैसे कि एआई कंपनियों के साथ अपने नए स्क्रिब मॉडल की पेशकश करते हैं, जो दस्त का समर्थन करते हैं और अंग्रेजी में 3.3% के बराबर त्रुटि दर को कम करते हैं। इसकी लागत इनपुट ऑडियो डीओ (या प्रति मिनट 00 0.006, लगभग समकक्ष) प्रति घंटे 0.40।

दूसरा स्टार्टअप, ह्यूम एआई, एक नया मॉडल, एक ऑक्टेव टीटीएस प्रदान करता है, जिसमें उपयोगकर्ता के निर्देशों के आधार पर एक लाइन-स्तर और शब्द-स्तरीय उच्चारण और भावनात्मक दृष्टिकोण का अनुकूलन होता है, न कि किसी भी पूर्व-सेट ध्वनियों के आधार पर। ऑक्टेव टीटीएस की कीमत सीधे तुलनीय नहीं है, लेकिन एक मुफ्त टायर है जो 10 मिनट ऑडियो देयो की लागत को बढ़ाता है और वहां से

इस बीच, अधिक उन्नत ऑडियो डियो और स्पीच मॉडल भी ओपन सोर्स समुदाय में आ रहे हैं, जिसमें एक नामक ऑर्फियस 3 बी भी शामिल है, जो कि अनुमेय अपाचे 2.0 लाइसेंस के साथ उपलब्ध है, जिसका अर्थ है कि डेवलपर्स को संचालित करने के लिए किसी भी लागत का भुगतान करने की आवश्यकता नहीं है – यदि उनके पास उपयुक्त हार्डवेयर या क्लाउड सर्वर हैं।

उद्योग को अपनाया और प्रारंभिक परिणाम

वेंचरबिट के साथ Openai द्वारा साझा किए गए प्रशंसापत्रों के अनुसार, कई कंपनियों ने पहले से ही अपने प्लेटफॉर्म पर ओपन ऑडियो डियो मॉडल डेलो को एकीकृत कर दिया है, आवाज में महत्वपूर्ण सुधारों की रिपोर्टिंग एआई एआई प्रदर्शन है।

एलिसी, एक कंपनी जो संपत्ति प्रबंधन ऑटो टोमेशन पर केंद्रित थी।

उन्नत आवाज़ों ने एआई-संचालित पट्टे, रखरखाव और यात्रा अनुसूची को अधिक आकर्षक बना दिया, जिससे अधिक किरायेदार संतुष्टि और कॉल एल रिज़ॉल्यूशन दर में सुधार हुआ।

Deccagon, जो Ai -operated आवाज के अनुभव बनाता है, ने Openai के भाषण मान्यता मॉडल का उपयोग करके प्रतिलेख सटीकता में सुधार देखा।

सटीकता में वृद्धि ने डिकैगन के एआई एजेंटों को शोर वातावरण में भी वास्तविक दुनिया के विचारों में अधिक विश्वसनीय प्रदर्शन करने की अनुमति दी है। समेकन प्रक्रिया तेज़ थी, जिसमें एक दिन के भीतर एक नए मॉडल को अपने सिस्टम में शामिल किया गया था।

Openai की नवीनतम रिलीज के लिए सभी प्रतिक्रियाएं गर्म नहीं हैं। डॉन एआई ऐप एनालिटिक्स एस। सॉफ्टवेयर फ्यूटीवियर के सह-संस्थापक बेन हाइलक (@Benhilek), पूर्व Apple पाल मानव इंटरफ़ेस डिजाइनर, ने एक्स पर पोस्ट किया कि जब मॉडल आशाजनक लगते हैं, “रियल-टाइम और वॉयस जैसी आवाज एक आवाज जैसी है,” नवीनतम ” Openai के पिछले ध्यान से दूर एक बदलाव को इंगित करता है।

इसके अलावा, प्रक्षेपण पहले एक्स (पिछले ट्विटर) पर प्रारंभिक रिसाव द्वारा किया गया था। TestingCatatalog News (@TestingCetlog) ने आधिकारिक घोषणा से कुछ मिनट पहले नए मॉडल पर विवरण पोस्ट किया, GPT-4 O-MINI-TTS, GPT-4 O-Transcript और GPT-4 O-MINI-Transcript की सूची। लिक को @Stiventhedev को श्रेय दिया गया था, और पोस्ट जल्दी से कर्षण था।

हालांकि, आगे देखते हुए, OpenAI ने अपने ऑडियो DIO मॉडल को बेहतर बनाने और सुरक्षा और जिम्मेदार AI उपयोग को सुनिश्चित करते हुए कस्टम आवाज का पता लगाने की क्षमता जारी रखने की योजना बनाई है। ऑडियो डियो के अलावा, Openai मल्टीमॉडल एआई में भी निवेश कर रहा है, जिसमें वीडियो सहित अधिक गतिशील और इंटरैक्टिव एजेंट -आधारित अनुभवों को सक्षम करने के लिए।

वीबी दैनिक के साथ पेशेवर उपयोग के मामलों पर दैनिक अंतर्दृष्टि

यदि आप अपने बॉस को प्रभावित करना चाहते हैं, तो वीबी ने आपको हर दिन कवर किया है। हम आपको एक अंदर के स्कूप देते हैं कि विनियामक शिफ्ट से लेकर प्रैक्टिकल परिनियोजन तक की कंपनियां एआई उत्पन्न करने के साथ क्या कर रही हैं, इसलिए आप अधिकतम आरओआई के लिए अंतर्दृष्टि साझा कर सकते हैं।

हमारी गोपनीयता नीति पढ़ें

सदस्यता के लिए धन्यवाद। यहां और अधिक वीबी न्यूज़लेटर्स देखें।

एक त्रुटि पाई गई।