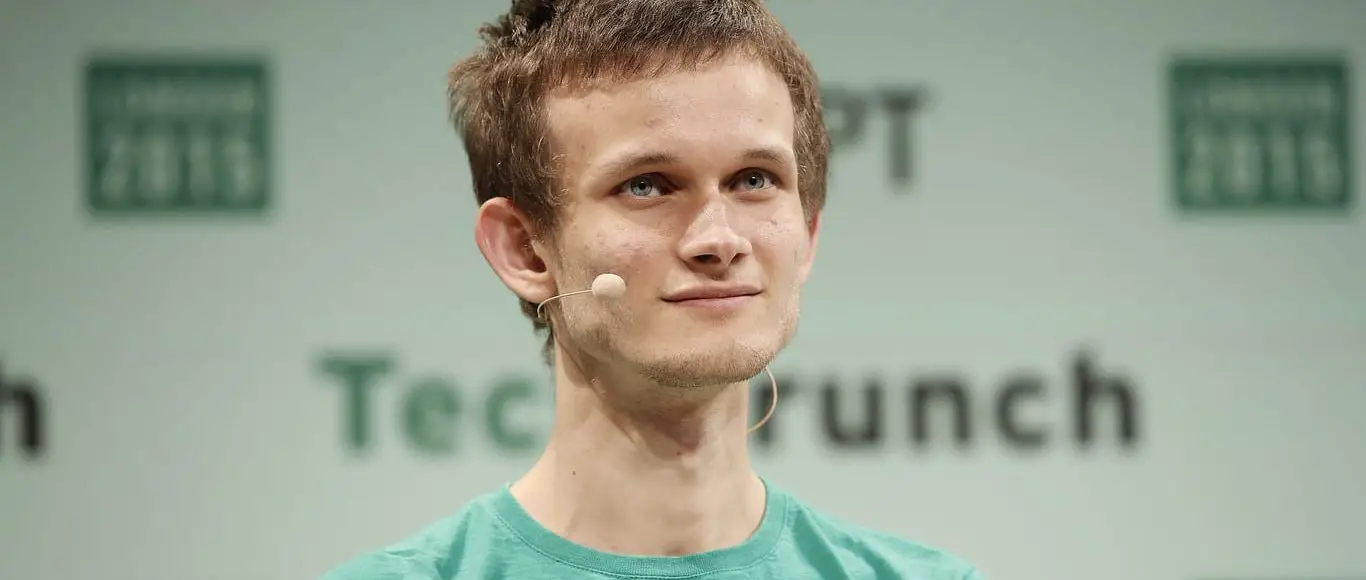

एजीआई जोखिम और तत्परता पर विटाल बटरिन

एजीआई के जोखिमों और तत्परता पर विटालिक ब्यूटिन कृत्रिम सामान्य खुफिया प्रगति के रूप में संभावित चुनौतियों को खत्म करने के महत्व पर प्रकाश डालता है। क्या हम गहरी चुनौतियों के लिए तैयार हैं जो वास्तव में इस तकनीक को ला सकते हैं? उनकी अंतर्दृष्टि ने एजीआई के छिपे हुए जोखिमों पर प्रकाश डाला और हमें यह प्रतिबिंबित करने के लिए मजबूर किया कि क्या समाज इन अभूतपूर्व प्रगति का प्रबंधन करने के लिए सुसज्जित है। एजीआई लाभों और जोखिमों के चौराहे का पता लगाने के लिए अपने आप को संभालें, क्योंकि हम इस परिवर्तनकारी अभी तक अस्थिर सीमा को पाते हैं।

यह भी पढ़ें: संगठन में एआई के अवसरों की पहचान करने के लिए

AGI क्या है और यह क्यों मायने रखता है?

आर्टिफिशियल जनरल इंटेलिजेंस, जिसे अक्सर एजीआई कहा जाता है, कृत्रिम बुद्धिमत्ता के विकास में एक उन्नत चरण का प्रतिनिधित्व करता है। वर्तमान एआई प्रणालियों के विपरीत, जो कुछ कार्यों में सबसे अच्छा है, एजीआई का उद्देश्य जुन्ब की एक विस्तृत श्रृंखला में मानव बुद्धिमत्ता की नकल करना है। यह जटिल तर्क कर सकता है, लगातार सीख सकता है, और विभिन्न संदर्भों में निर्णय ले सकता है।

संभावनाएं एजीआई अनल ओक्स भारी हैं। जब तक उद्योगों में क्रांति नहीं हो रही है, तब तक यह अभूतपूर्व लाभ का वादा करता है, जैसे कि मौसम परिवर्तन जैसी वैश्विक समस्याओं को हल करता है। लेकिन महान शक्ति के साथ महत्वपूर्ण जिम्मेदारी आती है – और जोखिम। विट्रिक बटरिन का सतर्क रवैया हमें याद दिलाता है कि यह परिवर्तनकारी तकनीक एक डबल -डेड तलवार है जिसे ठीक से संपर्क किया जाना चाहिए।

ALSO READ: सैम अल्टमैन आर्टिफिशियल जनरल इंटेलिजेंस के उदय की भविष्यवाणी करता है

एजीआई के छिपे हुए जोखिम

AGI को अद्वितीय नवाचार लाने की संभावना है, लेकिन यह उन खतरों को भी उठा सकता है जो भविष्यवाणी करना, प्रबंधन करना या कम करना मुश्किल है। एक बड़ा जोखिम एजीआई की स्वायत्तता के इर्द -गिर्द घूमता है। क्या होता है जब एक खुफिया प्रणाली न केवल मानव निर्णय से अधिक हो जाती है, बल्कि हमारी नैतिक और नैतिक संरचनाओं से परे भी चलती है?

विट्रीसिटी की एकाग्रता से जुड़े दूसरे खतरनाक परिदृश्य पर ध्यान केंद्रित करना। यदि एक इकाई, एक निगम या सरकार एक बहुत ही बुद्धिमान एजीआई प्रणाली पर पूर्ण नियंत्रण प्राप्त करती है, तो परिणाम जल्दी से डिस्टोपियन बन सकते हैं। इससे युद्ध या निगरानी में व्यापक आर्थिक असमानता, सामाजिक उथल -पुथल या एजीआई दुरुपयोग हो सकता है।

अवांछित परिणामों का भी खतरा है जो खराब संगठित लक्ष्यों से उत्पन्न होता है। AGI यह प्राप्त कर सकता है कि कार्यक्रम क्या करता है, लेकिन अगर इसके लक्ष्यों को मानवता के सर्वोत्तम हितों के साथ ठीक से व्यवस्थित नहीं किया जाता है, तो जिस तरह से यह लेता है वह विनाशकारी हो सकता है। इसे “कॉन्फ़िगरेशन की समस्या” कहा जाता है, और यह AGI जिम्मेदारी से विकसित करने के लिए सबसे कठिन चुनौतियों में से एक है।

ALSO READ: Micros .ft AI CEO 7 साल में AG की भविष्यवाणी करता है

क्या हम तकनीकी रूप से AGI के लिए तैयार हैं?

जी में एआई टेक्नोल में तेजी से प्रगति के बावजूद, एजीआई को सुरक्षित और स्केलेबल बनाने के लिए हमारी तत्परता के बारे में गंभीर सवाल हैं। बटरिन वर्तमान एआई बुनियादी ढांचे की ताकत पर चिंताओं को जारी करता है। क्या हम जो सिस्टम बनाते हैं, वह जटिलता को बनाए रख सकता है और बेहद बुद्धिमान एजीआई की मांग कर सकता है? इसके अलावा, क्या वे भयावह विफलता को रोकने में सक्षम सुरक्षा विधियाँ सुनिश्चित कर सकते हैं?

बटरिन डेटा पूर्वाग्रह, पारदर्शिता और देयता जैसे क्षेत्रों में नैतिक और तकनीकी चिंताएं भी अधिक हैं। यदि AGI सिस्टम अपने प्रशिक्षण डेटा में मौजूद पूर्वाग्रह की विरासत प्राप्त करते हैं, तो एक वास्तविक जोखिम है कि वे कई बड़े -स्केल प्रणालीगत अन्याय को बनाए रख सकते हैं। यह सवाल उठाता है: हम एल्गोरिदम कैसे बना सकते हैं जो न केवल उन्नत बल्कि स्वाभाविक रूप से धर्मी और प्रतिनिधि हैं?

Also Read: आर्टिफिशियल जनरल इंटेलिजेंस (AGI) क्या है?

प्रतिक्रिया और विनियमन: वैश्विक सहयोग की आवश्यकता

गवर्नेंस और अंतर्राष्ट्रीय सहयोग उन नीतियों की तैयारी के लिए आवश्यक हैं जो AGI के विकास और अनुप्रयोग का मार्गदर्शन कर सकते हैं। बटरिन दुनिया की वकालत करता है जहां सरकारें, निगम और शिक्षाविद एजीआई जोखिमों और पुरस्कारों के शोर के हाथों में काम करती हैं।

वैश्विक विनियमन इस तकनीक पर एकाधिकार या असंतुलित नियंत्रण को रोकने में मदद कर सकता है। यह यह सुनिश्चित करने के लिए एक नैतिक मार्गदर्शिका भी स्थापित कर सकता है कि एजीआई विकास सार्वभौमिक मानव मूल्यों के साथ आयोजित करता है। यह सहयोगी दृष्टिकोण स्वस्थ प्रतिस्पर्धा और नवाचार को बनाए रखते हुए विनाशकारी परिणामों को रोक सकता है।

सार्वजनिक रूप से क्या भूमिका है?

एजीआई का विकास न केवल एक तकनीकी चुनौती है, बल्कि सामाजिक भी है। यह AGI के निहितार्थ के बारे में आम जनता के लिए महत्वपूर्ण है और अपने भविष्य को आकार देने वाली चर्चाओं में शामिल होना चाहिए। बटरिन तकनीकी विकास में पारदर्शिता के महत्व पर जोर देता है। जबकि कंपनियां और शोधकर्ता खुले तौर पर अपने निष्कर्षों को साझा करते हैं, सुरक्षा, नैतिकता और संभावित जोखिमों के बारे में चल रही बातचीत बेहतर ढंग से समझ सकती है और योगदान कर सकती है।

एजीआई के भविष्य में हितधारकों के रूप में, समाज की भूमिका में उन प्रौद्योगिकियों के लिए दबाव शामिल होना चाहिए जो जिम्मेदार होल्डिंग और स्थायित्व और निगमन को पसंद करते हैं। शिक्षा और आउटरीच एजीआई को सशक्त बना सकते हैं ताकि रोजमर्रा की जिंदगी में एकीकृत किया जा सके।

आर्थिक प्रभाव एजीआई

एजीआई का सबसे चर्चा का पहलू वैश्विक अर्थव्यवस्था पर इसका संभावित प्रभाव है। एक ओर, AGI में उत्पादकता के टर्बोचार्ज, दोहरावदार कार्यों को स्वचालित करने और एक नया व्यवसाय बनाने की क्षमता है। दूसरी ओर, यह श्रम बाजारों को अस्थिर कर सकता है, जिससे लाखों नौकरियां अप्रचलित हो सकती हैं। इस संबंध में एजीआई की विघटनकारी शक्ति को कम करने के खिलाफ विट्लिक बटरिन चेतावनी देता है।

चुनौती आर्थिक स्थिरता के साथ नवाचार को संतुलित करेगी। नीतिगत निर्णयों को असमानता को कम करने के लिए पुनर्वास की पहल और सार्वभौमिक बुनियादी आय जैसे अनुप्रयोगों के माध्यम से नौकरी के विस्थापन को सक्रिय रूप से संबोधित करने की आवश्यकता होगी। कारोबार भी कर्मचारियों को सामाजिककरण के बिना इस उदाहरण को अपनाने की पुष्टि करने में भी भूमिका निभाएंगे।

ALSO READ: द पाथ टू आर्टिफिशियल कॉमन इंटेलिजेंस आसान है

एगी सुरक्षा नैतिक वादा

एजीआई विकास की सभी व्यावहारिक चीजों को ध्यान में रखते हुए एक महत्वपूर्ण नैतिक आवश्यक है: यह सुनिश्चित करना कि एजीआई संपूर्ण मानवता को लाभान्वित करता है। विटालेक का दावा है कि सुरक्षित कार्यान्वयन केवल एक तकनीकी समस्या नहीं है – यह एक नैतिक है। यह निर्धारित करने के लिए कि एजीआई द्वारा किसका उपयोग किया जाता है? क्या हाशिए के समूहों में आयोजित समूहों की आवाज़ उसके भाग्य को आकार देने के लिए है?

एक नैतिक सहमति तक पहुंचने के लिए मेज पर विभिन्न ध्वनियों की आवश्यकता होगी। AGI विकास को AGI विकास में शामिल किया जाना चाहिए ताकि यह सुनिश्चित किया जा सके कि मौजूदा सामाजिक असमानताएं अधिक नहीं हैं या नया नहीं करती हैं। नैतिक संरचना में, प्रारंभिक अनुसंधान से लेकर बड़े पैमाने पर तैनाती तक प्रत्येक कदम को निर्देशित किया जाना चाहिए।

मानवता और एजीआई के आगे क्या है?

जैसा कि बटरिन ने सुझाव दिया है, एजीआई की ओर दौड़ अब “अगर” लेकिन “जब” का सवाल नहीं है। प्रगति की तीव्र गति का मतलब है कि एजीआई विकास के लिए समयरेखा सबसे अधिक उम्मीदों से कम हो सकती है। यह आग्रह प्रतिक्रियाशील उपायों के बजाय एक सक्रिय दृष्टिकोण के लिए कहता है, यह सुनिश्चित करता है कि मानवता इस नए युग में सावधानी से चलती है।

सुरक्षा को प्राथमिकता देने वाले महत्वपूर्ण मोर्चे के चरणों में अनुसंधान में निवेश करना, अंतःविषय सहयोग का विस्तार करता है, और गंभीर रूप से एजीआई के सामाजिक और सांस्कृतिक प्रभावों का विश्लेषण करता है। सरकारों, प्रौद्योगिकीविदों और व्यापक लोगों को इस बात की व्यवस्था करनी चाहिए कि जिम्मेदार प्रगति का निर्माण क्या है।

क्या एजीआई अभूतपूर्व अच्छे के लिए बल है कि अनावश्यक नुकसान का अग्रदूत आज हमारे द्वारा किए गए विकल्पों पर निर्भर करेगा।

निष्कर्ष: संतुष्टि पर एक जिम्मेदारी चुनना

एजीआई के जोखिमों और तत्परता पर महत्वपूर्ण बटरिन अंतर्दृष्टि समाज के बारे में जागरूक समाज के लिए एक कॉल के रूप में काम करती है। कृत्रिम जनरल इंटेलिजेंस का वादा उतना ही आकर्षक है जितना कि यह हताश है। जैसा कि हम एक तकनीकी क्रांति के कगार पर स्टैंड पर रहते हैं, अगला पथ परिश्रम, सहयोग और जिम्मेदारी की मांग करता है।

एजीआई के विकास को जिम्मेदारी से निर्देशित करने के लिए मानवता की शक्ति के अंदर, यह सुनिश्चित करता है कि यह ग्राउंडब्रेकिंग तकनीक बेहतर के लिए काम करती है। अपने छिपे हुए जोखिमों को बढ़ावा देने और पारदर्शी प्रवचन को बढ़ावा देने से, हम भविष्य के लिए तैयार कर सकते हैं जहां एजीआई को समाज को कमजोर करने के बजाय उठाया जाता है।

बटरिन के अनुसार, हमारी तत्परता केवल तकनीकी रूप से संरचनात्मक नहीं है – यह नैतिक स्पष्टता और सामूहिक कार्रवाई के बारे में है। हम जो विकल्प व्यक्तिगत रूप से और सामूहिक रूप से बनाते हैं, वह निर्धारित करेगा कि एजीआई मानवता का सबसे बड़ा भागीदार या इसकी सबसे बड़ी चुनौती बन जाता है।